OUVERTURE

Les chercheurs soulignent que le problème est difficile à étudier car les machines surhumaines n’existent pas. Ils ont donc utilisé des remplaçants. Au lieu d’examiner comment les humains pourraient superviser des machines surhumaines, ils ont examiné comment GPT-2, un modèle lancé par OpenAI il y a cinq ans, pourrait superviser GPT-4, le modèle le plus récent et le plus puissant d’OpenAI. « Si vous y parvenez, cela pourrait être la preuve que vous pouvez utiliser des techniques similaires pour que des humains supervisent des modèles surhumains », explique Collin Burns, un autre chercheur de l’équipe de superalignement.

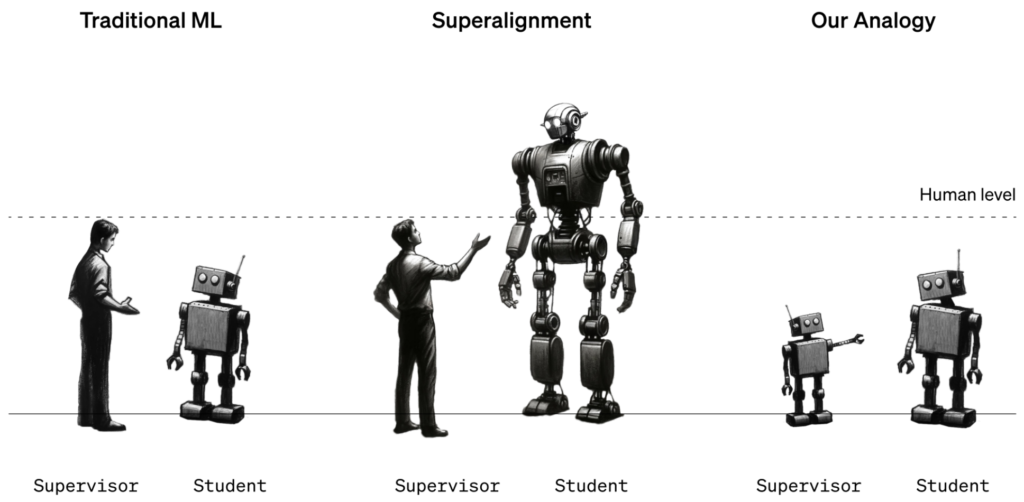

L’équipe a suivi GPT-2 et l’a entraîné à effectuer une poignée de tâches différentes, notamment un ensemble de puzzles d’échecs et 22 tests courants de traitement du langage naturel qui évaluent l’inférence, l’analyse des sentiments, etc. Ils ont utilisé les réponses de GPT-2 à ces tests et énigmes pour entraîner GPT-4 à effectuer les mêmes tâches. C’est comme si un élève de 12ème apprenait à accomplir une tâche par un élève de 3ème. L’astuce était de le faire sans que GPT-4 ne subisse un trop gros impact sur les performances.

Les résultats ont été mitigés. L’équipe a mesuré l’écart de performance entre GPT-4 formé sur les meilleures suppositions de GPT-2 et GPT-4 formé sur les réponses correctes. Ils ont constaté que GPT-4 entraîné par GPT-2 était 20 à 70 % plus performant que GPT-2 sur les tâches linguistiques, mais moins performant sur les énigmes d’échecs.

Le fait que GPT-4 ait surpassé son professeur est impressionnant, déclare Pavel Izmailov, membre de l’équipe : « C’est un résultat vraiment surprenant et positif. » Mais il est loin de ce qu’il pourrait faire par lui-même, dit-il. Ils concluent que l’approche est prometteuse mais nécessite davantage de travail.

« C’est une idée intéressante », déclare Thilo Hagendorff, chercheur en IA à l’Université de Stuttgart en Allemagne qui travaille sur l’alignement. Mais il pense que GPT-2 est peut-être trop stupide pour être un bon professeur. « GPT-2 a tendance à donner des réponses absurdes à toute tâche légèrement complexe ou nécessitant un raisonnement », dit-il. Hagendorff aimerait savoir ce qui se passerait si GPT-3 était utilisé à la place.

Il note également que cette approche ne répond pas au scénario hypothétique de Sutskever dans lequel une superintelligence cache son véritable comportement et prétend être alignée alors qu’elle ne l’est pas. « Les futurs modèles surhumains posséderont probablement des capacités émergentes inconnues des chercheurs », explique Hagendorff. « Comment l’alignement peut-il fonctionner dans ces cas-là ?

Mais il est facile de signaler des lacunes, dit-il. Il est heureux de voir OpenAI passer de la spéculation à l’expérimentation : « J’applaudis OpenAI pour ses efforts. »

OpenAI souhaite désormais en recruter d’autres à sa cause. Parallèlement à cette mise à jour de la recherche, la société a annoncé une nouvelle cagnotte de 10 millions de dollars qu’elle prévoit d’utiliser pour financer les personnes travaillant sur le superalignement. Il offrira des subventions pouvant atteindre 2 millions de dollars aux laboratoires universitaires, aux organisations à but non lucratif et aux chercheurs individuels, ainsi que des bourses d’études d’un an de 150 000 dollars aux étudiants diplômés. « Nous sommes vraiment enthousiasmés par cette initiative », déclare Aschenbrenner. « Nous pensons vraiment que les nouveaux chercheurs peuvent apporter beaucoup. »